OpenAI запускает GPT-4o — большую мультимодальную языковую модель, поддерживающую общение в реальном времени, вопросы и ответы, генерацию текста и многое другое.

OpenAI — один из поставщиков, сформировавших эру генеративного ИИ . Основой успеха и популярности OpenAI является семейство больших языковых моделей (LLM) компании GPT , включая GPT-3 и GPT-4, а также сервис разговорного ИИ компании ChatGPT .

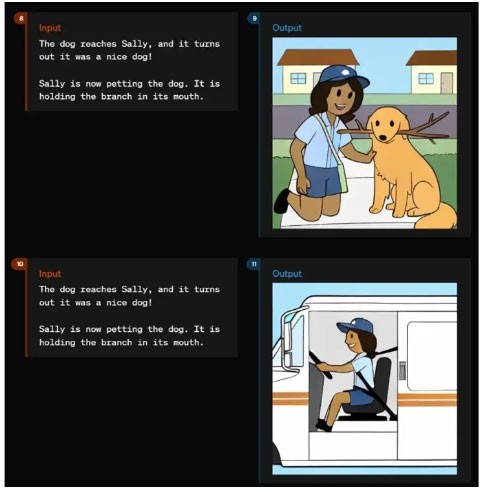

13 мая 2024 года во время мероприятия Spring Updates компания OpenAI анонсировала GPT-4 Omni (GPT-4o) в качестве новой флагманской мультимодальной языковой модели компании. В рамках мероприятия компания OpenAI выпустила несколько видеороликов, демонстрирующих возможности интуитивной голосовой обратной связи и вывода данных модели.

В июле 2024 года OpenAI выпустила уменьшенную версию GPT-4o — GPT-4o mini . Это самая совершенная малая модель компании.

Что такое GPT-4o?

GPT-4o — флагманская модель в портфеле технологий LLM компании OpenAI. «O» означает Omni и представляет собой не просто маркетинговую рекламу, а скорее указывает на множественные модальности модели для текста, изображений и аудио.

Модель GPT-4o знаменует собой новую эволюцию GPT-4 LLM, впервые выпущенной OpenAI в марте 2023 года. Это также не первое обновление GPT-4, поскольку модель впервые была представлена в ноябре 2023 года с выпуском GPT-4 Turbo. Аббревиатура GPT расшифровывается как Generative Pre-Trained Transformer (Генеративный Предварительно Обученный Трансформатор). Модель трансформатора является основополагающим элементом генеративного ИИ, предоставляя архитектуру нейронной сети, способную понимать и генерировать новые результаты.

GPT-4o значительно превосходит GPT-4 Turbo как по возможностям, так и по производительности. Как и его предшественник GPT-4, GPT-4o можно использовать в случаях, когда требуется генерация текста, например, резюме, вопросов и ответов, основанных на знаниях. Эта модель также способна рассуждать, решать сложные задачи и программировать.

Модель GPT-4o представляет собой новый быстрый отклик на аудиовход, который, по данным OpenAI, аналогичен человеческому: среднее время отклика составляет 320 миллисекунд. Модель также может отвечать голосом, сгенерированным искусственным интеллектом, который звучит как человеческий.

Вместо отдельных моделей, которые понимают звук, изображения (в OpenAI это называется зрением) и текст, GPT-4o объединяет эти модальности в единую модель. Таким образом, GPT-4o может распознавать любую комбинацию текста, изображений и аудиовхода и выдавать ответ в любой из этих форм.

GPT-4o и его возможности высокоскоростной аудиомультимодальной обратной связи обещают, что модель сможет взаимодействовать с пользователями более естественно и интуитивно.

GPT-4o mini — самая быстрая модель OpenAI, позволяющая создавать приложения с меньшими затратами. GPT-4o mini умнее GPT-3.5 Turbo и на 60% дешевле. Данные обучения охватывают период до октября 2023 года. GPT-4o mini доступен в текстовых и визуальных моделях для разработчиков через API Assistants, API Chat Completions и Batch API. Мини-версия также доступна для пользователей ChatGPT, Free, Plus и Team.

Что может GPT-4o?

На момент своего выпуска GPT-4o была самой мощной из всех моделей OpenAI с точки зрения как функциональности, так и производительности.

GPT-4o может делать много вещей, в том числе:

- Взаимодействие в реальном времени . Модель GPT-4o может участвовать в устном общении в реальном времени без каких-либо заметных задержек.

- Вопросы и ответы на основе знаний . Как и все предыдущие модели GPT-4, GPT-4o был обучен с использованием базы знаний и может отвечать на вопросы.

- Обобщите и сгенерируйте текст . Как и все предыдущие модели GPT-4, GPT-4o может выполнять общие задачи LLM по тексту, включая реферирование и генерацию текста.

- Мультимодальное рассуждение и генерация . GPT-4o объединяет текст, речь и изображения в единую модель, что позволяет осуществлять комбинированную обработку и реагирование на типы данных. Модель может понимать аудио, изображения и текст с одинаковой скоростью. Он также может генерировать обратную связь посредством аудио, визуальных эффектов и текста.

- Обработка языка и звука . GPT-4o обладает расширенными возможностями обработки более 50 различных языков.

- Анализ настроений . Модель анализирует настроения пользователей при просмотре различных форматов текста, аудио и видео.

- Тон голоса . GPT-4o может генерировать голоса с эмоциональными нюансами. Это делает его эффективным для приложений, требующих деликатной и тонкой коммуникации.

- Анализ аудиоконтента . Модель может генерировать и понимать устную речь, что может применяться в системах с голосовым управлением, анализе аудиоконтента и интерактивном повествовании.

- Перевод в реальном времени. Мультимодальные возможности GPT-4o позволяют осуществлять перевод с одного языка на другой в режиме реального времени.

- Понимание изображений и видео. Модель может анализировать изображения и видео, позволяя пользователям загружать визуальный контент, который GPT-4o может понять, интерпретировать и проанализировать.

- Анализ данных . Возможности рассуждения и зрения позволяют пользователям анализировать данные, содержащиеся в диаграммах данных. GPT-4o также может создавать диаграммы данных на основе анализа или подсказок.

- Загрузить файл. Помимо пороговых значений знаний, GPT-4o поддерживает загрузку файлов, позволяя пользователям предоставлять определенные данные для анализа.

- Контекстуальная осведомленность и память. GPT-4o может помнить предыдущие взаимодействия и поддерживать контекст в длительных разговорах

- Большое контекстное окно . Благодаря контекстному окну, поддерживающему до 128 000 токенов, GPT-4o может поддерживать согласованность в длинных разговорах или документах, что делает его пригодным для детального анализа.

- Уменьшение галлюцинаций и повышение безопасности . Модель призвана свести к минимуму создание неточной или вводящей в заблуждение информации. GPT-4o включает в себя расширенные протоколы безопасности, гарантирующие пользователям единообразный и безопасный вывод.

Как использовать GPT-4o

Пользователи и организации могут использовать GPT-4o несколькими способами.

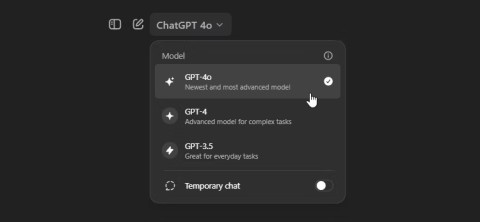

- ChatGPT бесплатен. Модель GPT-4o будет доступна бесплатно пользователям чат-бота ChatGPT от OpenAI. Когда появится возможность, GPT-4o заменит текущую версию по умолчанию для пользователей ChatGPT Free. Пользователи ChatGPT Free будут иметь ограниченный доступ к сообщениям и не смогут пользоваться некоторыми расширенными функциями, включая загрузку файлов и аналитику данных.

- ЧатGPT Плюс . Пользователи платной версии сервиса OpenAI для ChatGPT получат полный доступ к GPT-4o без ограничений функций, доступных бесплатным пользователям.

- API-доступ . Разработчики могут получить доступ к GPT-4o через API OpenAI. Это позволяет интегрировать его в приложения, чтобы в полной мере использовать возможности GPT-4o для решения задач.

- Настольное приложение. OpenAI интегрировала GPT-4o в настольные приложения, включая новое приложение для macOS от Apple, которое также было выпущено 13 мая.

- Пользовательский GPT. Организации могут создавать собственные версии GPT-4o в соответствии с конкретными потребностями бизнеса или отдела. Пользовательские модели, скорее всего, будут доступны пользователям через GPT Store компании OpenAI.

- Службы Microsoft OpenAI. Пользователи могут изучить возможности GPT-4o в режиме предварительного просмотра в Microsoft Azure OpenAI Studio, который специально разработан для обработки многомодальных входных данных, включая текст и зрение. Этот первоначальный выпуск позволяет клиентам Azure OpenAI Service экспериментировать с возможностями GPT-4o в контролируемой среде, а в будущем планируется расширить его возможности.

Кроме того, читатели могут обратиться к разделу: Различия между GPT-4, GPT-4 Turbo и GPT-4o .